インフラエンジニアやSRE(Site Reliability Engineering)の業務において、最も精神的・肉体的な負担が大きいのが「深夜の監視アラート対応」です。午前3時にスマートフォンのPagerDutyやSlackが鳴り響き、眠い目をこすりながらVPNを繋ぎ、ターミナルで難解なエラーログと格闘する……。そんな過酷な経験を持つエンジニアは決して少なくないでしょう。

ZabbixやPrometheusといった強力な監視ツールは、「CPU使用率が90%を超えた」「Nginxプロセスがダウンした」「Webサーバーからの応答ステータスが502になった」といった事象(Symptoms)を正確かつリアルタイムに検知してくれます。しかし、「なぜそれが起きたのか(Root Cause)」と「今すぐ何をすべきか(Action)」までは教えてくれません。これまでは、属人的な経験則とカンを頼りに、複数のサーバーにSSH接続してログを漁るしかありませんでした。

本連載「Linuxエンジニアのための生成AI」第5回となる今回は、生成AIを「Tier 1(一次対応)のバーチャル・インシデントコマンダー」として監視システムに組み込む、画期的な手法を解説します。アラート発生時に、Bashスクリプトが直近のログを自律的に収集・AIへ送信し、障害の根本原因と実行すべき復旧コマンドをSlackに要約して通知する。そんな夢のような「自己修復(Auto-Remediation)への第一歩」となる自動化パイプラインを、AlmaLinux 9環境をベースに構築していきます。

📚 関連シリーズのアーカイブ

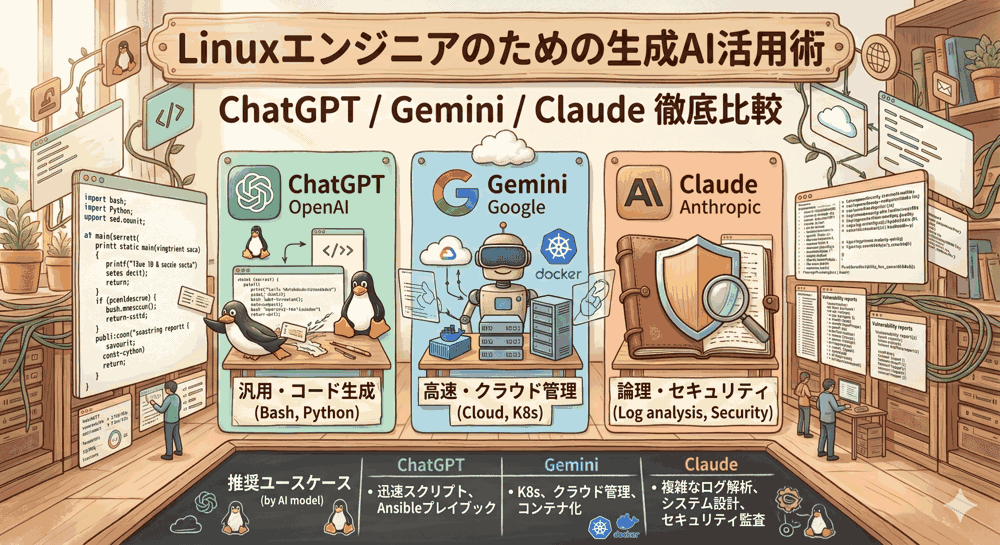

- 【連載 第1回】ChatGPT・Gemini・Claudeの徹底比較とCLI連携

- 【連載 第2回】BashスクリプトとAIの融合:Apacheログの異常検知とIP自動ブロック

- 【連載 第3回】Ansible Playbookの自動生成とテスト手法

- 【連載 第4回】コンテナ構築を生成AIで極める:セキュアなDockerfile自動生成

- 【連載 第5回】監視アラート対応を生成AIで自動化(本記事)

- 【別シリーズ】サーバー管理入門 最終回:ユーザーからのクレームを待つな。「監視」の技術とプロの運用論

- 【別シリーズ】Ansible講座 付録:自律的な運用へ。Event-Driven Ansible (EDA) とAutomation Platformの全貌

リナックス先生!最近、Zabbixのアラート通知をSlackに流すようにしたんですが、情報が多すぎて結局「何が起きてるの?」って手動でサーバーに入って確認してます。特に夜中は頭が働かないので、エラーログの解析だけでも誰か代わりにやってほしいです……。

コウ君、それこそが現代のインフラ運用が抱える「アラート・ファティーグ(警告疲れ)」の典型的な症状よ!人間がログの海からエラーメッセージを探し出す時代は終わったわ。今日は、Zabbixのアクション機能と生成AIのAPIを連動させて、アラート通知の中に「AIの推論結果」を埋め込むプロのテクニックを伝授するわよ!

目次

1. 監視システムとAIを連携させるアーキテクチャ設計

システムを自動化するにあたり、まずは全体像(アーキテクチャ)を設計します。ただ闇雲にAIへデータを投げつけるのではなく、AIが推論しやすいように情報を加工して渡す「前処理(Pre-processing)」が成功の鍵を握ります。

1-1. 従来のアラート通知の課題(ノイズと文脈の欠如)

ZabbixやPrometheus(Alertmanager)から送られてくる標準的なSlack通知は、おおむね次のようなものです。

【障害発生】 ホスト名: webserver-01.alma9.local トリガー: Nginx service is down 深刻度: High 値: 0

この通知を見たエンジニアは、「Nginxが落ちたことは分かった。でも、なぜ?」という疑問を持ちます。OOM Killerにプロセスが強制終了されたのか、誰かが誤った設定ファイル(nginx.conf)をリロードしてSyntax Errorで落ちたのか、ディスクフル(No space left on device)でログが書き込めずに停止したのか。この「文脈」が欠如しているため、初動対応に遅れが生じます。

1-2. AIによる「トリアージ(一次切り分け)」の自動化フロー

そこで、アラートの発生から通知までの間に、以下の処理を挟み込みます。

- 検知(Zabbix/Prometheus): トリガーが発火し、外部のBashスクリプトをキック(実行)する。

- コンテキスト収集(Bash): スクリプトが対象サーバーの

journalctlや/var/log/messagesから、直近5分間のエラーログ(文脈)を抽出する。 - 推論(生成AI API): 抽出したログとアラート内容をAI(GPT-4oやClaude 3.5 Sonnet)に渡し、「根本原因の推論」と「復旧のための推奨コマンド」を出力させる。

- 通知(Slack Webhook): 元のアラート情報にAIの推論結果を付与し、人間が読みやすいリッチなフォーマットでSlackへPOSTする。

2. アラート発生時のトリガーとログ抽出(前処理)

AIに精度の高い推論をさせるためには、「障害発生時の生のログデータ」が不可欠です。Zabbixのアクション機能を利用して、対象サーバーの直近ログを自動取得する仕組みを作ります。

2-1. Zabbixアクションとマクロ変数の活用

Zabbixの「アクションの実行内容」として、Zabbix Server上でスクリプトを実行させます。この際、Zabbixが持っている組み込みマクロ(変数)を引数としてBashスクリプトに渡します。

実行するスクリプトのコマンド例:

/usr/local/bin/ai_alert_handler.sh "{HOST.NAME}" "{EVENT.NAME}" "{ITEM.KEY}"

{HOST.NAME}:障害が発生したホスト名。{EVENT.NAME}:トリガー名(例: Nginx service is down)。{ITEM.KEY}:監視アイテムのキー。これにより、どのサービスやリソースに関する障害かを判定します。

2-2. systemd/journalctlを利用した直近エラーログの動的取得

AlmaLinux 9環境では、システムやサービスのログは systemd のジャーナル(journald)に統合されています。Bashスクリプト内で、引数として受け取ったトリガー名から対象サービスを推測し、直近のログを引っ張ってきます。

# スクリプトの一部抜粋

HOST=$1

EVENT_NAME=$2

ITEM_KEY=$3

# Zabbix Serverから対象ホストにSSHでコマンドを投げ、直近100行のログを取得する

# (※鍵認証でzabbixユーザーが対象サーバーへSSHできる前提)

# サービスダウン系のアラートであれば、対象のsystemdログを抽出

if [[ "$EVENT_NAME" == *"Nginx"* ]]; then

SERVICE_NAME="nginx"

LOG_DATA=$(ssh -o StrictHostKeyChecking=no zabbix@$HOST "sudo journalctl -u $SERVICE_NAME -n 100 --no-pager")

elif [[ "$EVENT_NAME" == *"MySQL"* || "$EVENT_NAME" == *"MariaDB"* ]]; then

SERVICE_NAME="mysqld"

LOG_DATA=$(ssh -o StrictHostKeyChecking=no zabbix@$HOST "sudo journalctl -u $SERVICE_NAME -n 100 --no-pager")

else

# その他の一般的なシステムエラーの場合はmessagesを抽出

LOG_DATA=$(ssh -o StrictHostKeyChecking=no zabbix@$HOST "sudo tail -n 100 /var/log/messages")

fi

なるほど!単にアラートのテキストをAIに投げるんじゃなくて、スクリプト側で「今まさに落ちた瞬間のログ」をサーバーから直接取ってきて、それをAIに読ませるんですね。これならAIも「ああ、設定ファイルの32行目でSyntax Errorが起きてるな」って一発で分かりますね!

3. インシデント解析スクリプトの実装(Bash + jq + curl)

ログが取得できたら、いよいよ生成AI(今回は速度とコストのバランスが良い OpenAI の GPT-4o-mini を想定)のAPIを呼び出します。

3-1. AIに「SREとしての推論」を強制するシステムプロンプト

AIにはダラダラとした「解説」ではなく、実務ですぐに使える「実用的なレポート」を書かせる必要があります。出力フォーマットをJSONに固定し、プログラム側で扱いやすくします。

システムプロンプトの設計:

あなたはプロのSRE(Site Reliability Engineer)です。

以下の監視アラート内容と、対象サーバーから抽出したエラーログを分析し、JSONフォーマットでインシデントレポートを出力してください。

【制約事項】

- JSON以外のテキスト(Markdownのバッククォート等)は一切含めないでください。

- 原因は端的かつ技術的に記載してください。

- 復旧コマンドはAlmaLinux 9環境で実行可能な具体的なコマンドとしてください。

【出力JSONスキーマ】

{

"root_cause": "障害の根本原因(推定)",

"impact": "システムへの影響と緊急度",

"suggested_action": "推奨される復旧コマンドや対応手順(文字列の配列)"

}

3-2. スクリプト本体のコーディング(API通信とエラーハンドリング)

以前の記事でも使用した jq と curl のコンボで、堅牢なAPIリクエストを構築します。

#!/bin/bash

# Zabbixから渡された引数

HOST="$1"

EVENT="$2"

LOG_DATA="$3" # 前段の処理で取得したログデータ

# APIキーの読み込み

source /etc/zabbix/ai_credentials.env

PROMPT="【アラート内容】\nホスト: ${HOST}\nイベント: ${EVENT}\n\n【ログデータ】\n${LOG_DATA}"

# JSONペイロードの安全な生成

JSON_PAYLOAD=$(jq -n \

--arg model "gpt-4o-mini" \

--arg sys "$SYSTEM_PROMPT" \

--arg usr "$PROMPT" \

'{

model: $model,

response_format: { type: "json_object" },

messages: [

{role: "system", content: $sys},

{role: "user", content: $usr}

],

temperature: 0.1

}')

# APIリクエスト (タイムアウト30秒設定)

RESPONSE=$(curl -s --max-time 30 -X POST "https://api.openai.com/v1/chat/completions" \

-H "Content-Type: application/json" \

-H "Authorization: Bearer $OPENAI_API_KEY" \

-d "$JSON_PAYLOAD")

# APIからの応答をパースして抽出

ROOT_CAUSE=$(echo "$RESPONSE" | jq -r '.choices[0].message.content | fromjson | .root_cause')

SUGGESTED_ACTION=$(echo "$RESPONSE" | jq -r '.choices[0].message.content | fromjson | .suggested_action | join("\n")')

⚠️ プロの視点:タイムアウト設定の必須化

監視システムの一部として外部APIを呼び出す場合、API側の遅延や一時的な障害によって監視システム全体がロックしてしまう(プロセスが滞留する)リスクがあります。curl には必ず --max-time 30(最大実行時間)を設定し、APIが応答しない場合はタイムアウトさせて標準のアラートのみを通知する「フェイルセーフ設計」にしてください。

4. Slackへのリッチ通知と自動復旧(Auto-Remediation)への展望

AIの解析結果を受け取ったら、それを現場のエンジニアが直感的に理解しやすい形に整形してSlackへ送ります。

4-1. Slack Webhookを用いた見やすいフォーマットの構築

SlackのIncoming Webhookを利用し、Blocks(リッチテキストレイアウト)を使って見やすくフォーマットします。

# Slackへの通知ペイロード構築

SLACK_PAYLOAD=$(jq -n \

--arg host "$HOST" \

--arg event "$EVENT" \

--arg cause "$ROOT_CAUSE" \

--arg action "$SUGGESTED_ACTION" \

'{

blocks: [

{

type: "header",

text: { type: "plain_text", text: "🚨 障害発生: \($event)", emoji: true }

},

{

type: "section",

fields: [

{ type: "mrkdwn", text: "*対象ホスト:*\n\($host)" }

]

},

{

type: "divider"

},

{

type: "section",

text: { type: "mrkdwn", text: "🤖 *AIインシデント解析レポート*" }

},

{

type: "section",

text: { type: "mrkdwn", text: "*【根本原因の推定】*\n```\n\($cause)\n```" }

},

{

type: "section",

text: { type: "mrkdwn", text: "*【推奨される復旧コマンド】*\n```bash\n\($action)\n```" }

}

]

}')

# SlackへPOST

curl -X POST -H 'Content-type: application/json' --data "$SLACK_PAYLOAD" "$SLACK_WEBHOOK_URL"

この通知が届くことで、エンジニアはスマートフォンを見た瞬間に「Nginxの設定ファイルの文法エラーだな。AIが提示している nginx -t と systemctl restart nginx を実行すれば直りそうだ」と判断でき、初動対応のスピードが劇的に向上します。

4-2. (応用)AIが提案したコマンドの人間承認ループ(Human-in-the-Loop)

AIの解析精度が十分に上がってくれば、Slack上に「復旧コマンドを実行する」というボタン(Slack Interactive Message)を配置し、エンジニアが「Approve(承認)」ボタンを押すだけで、裏側の自動化ツール(Ansible Automation Platform等)がコマンドを実行する「Human-in-the-Loop(人間を介在させた)自動復旧システム」への昇華も可能になります。これは最新のSREプラクティスの最前線です。

AIに「完全な無人での自動復旧」を任せるのはまだ危険よ。誤検知で再起動ループに入ったり、データベースを破壊したりする可能性があるからね。あくまでAIは「提案」まで。最終的な実行判断(トリガーを引く)のは人間のエンジニアが行う設計にするのが、現在のエンタープライズ運用におけるベストプラクティスよ。

5. セキュリティと運用上の注意点(ハルシネーション対策)

ログデータを外部のAI APIへ送信する際、最も注意すべきは「機密情報の漏洩」です。

機密情報のマスキング徹底

エラーログの中には、データベースの接続パスワード、顧客の個人情報、セッションID、APIトークンなどが平文で含まれている可能性があります。スクリプト内で、これらをAIに送信する前に強力なフィルタリングをかける必要があります。

# パスワードやクレジットカード番号らしき文字列をマスクする前処理の例

MASKED_LOG=$(echo "$LOG_DATA" | sed -E 's/password=[^& ]+/password=[REDACTED]/g' | sed -E 's/[0-9]{4}-[0-9]{4}-[0-9]{4}-[0-9]{4}/[CARD_MASKED]/g')

コンプライアンス要件が厳しいシステムの場合は、API経由でパブリックなAIを使用するのではなく、オンプレミス環境にオープンソースのLLM(Llama 3など)を構築し、外部にログを出さずにローカルAIで解析を行う構成も視野に入れるべきです。

6. 第5回の総まとめと次回予告

本記事では、インフラ運用の最大のペインポイントである「監視アラート対応」を、生成AIを一次対応のインシデントコマンダーとして組み込むことで効率化する実践的な手法を解説しました。

ZabbixやPrometheusの通知に、AIによる「根本原因の推論」と「復旧コマンドの提案」が付随することで、エンジニアの認知負荷は大幅に下がり、MTTR(平均修復時間)の劇的な短縮が期待できます。アラート地獄に悩む現場のエンジニアは、ぜひこの「AIアシスタント連携」を取り入れてみてください。

次回の【第6回】セキュリティ監査の自動化:AIによるサーバー設定の脆弱性診断とレポート作成では、AlmaLinux 9環境のセキュリティ設定(SELinux、firewalld、SSH設定など)をAIに網羅的にチェックさせ、プロ顔負けのセキュリティ監査レポートを自動生成する手法について解説します。お楽しみに!

▼ 【SRE・監視基盤を構築してAI連携を試そう】 ▼

ZabbixやPrometheusを動かすなら

「高コスパおすすめVPS」

SREとしての市場価値を高める

「ITエンジニア専門転職」

コメント